【セキュリティ文明開化シリーズ】

情報セキュリティ専門家として30年以上の経験を持つ山崎文明が、セキュリティ分野における世界での出来事を新たな視点や切り口でお届けします。

-------------------------------------------------------------

前回は、生成型AIの学習データセットのリスクについてお話ししました。今回は2024年の幕開けとして、各国において昨年までのAIの動向やどのような議論がなされたかについて振り返ってみたいと思います。

- ライター:山崎 文明

- 情報セキュリティ専門家として30年以上の経験を活かし、安全保障危機管理室はじめ、政府専門員を数多く勤めている。講演や寄稿などの啓発活動を通じて、政府への提言や我が国の情報セキュリティ水準の向上に寄与している

目次

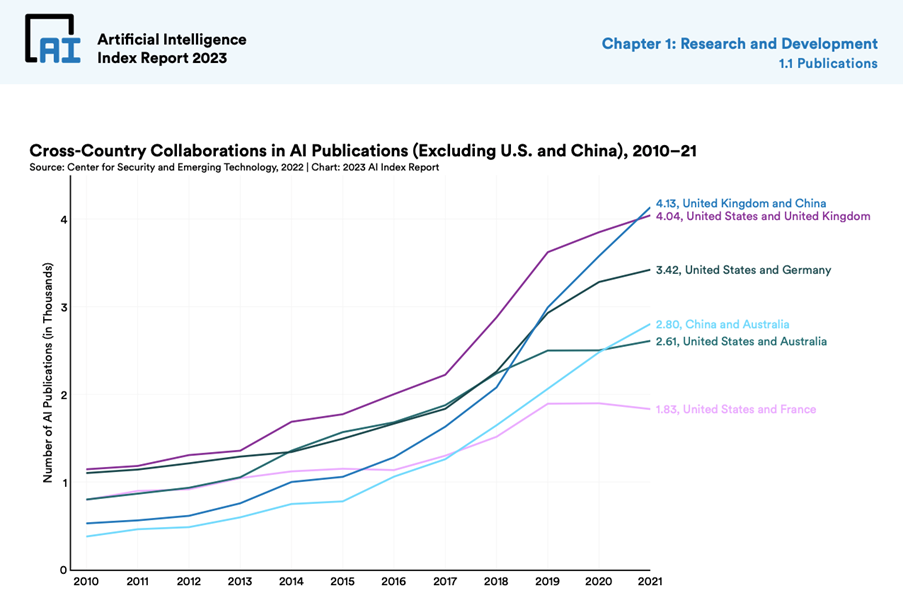

AIへの投資はひと段落

まず、初めに紹介するのは米スタンフォード大学が2023年4月3日に発表した「 Ai Index Reort 2023」についてです。この報告書では2022年のAIに対する民間投資額が919億ドルだったとしています。この数字は、2021年よりも26.7%も減少しており、過去10年の前年比で初めて減少したとしています。AIの開発もピークを超え、いよいよ実使用段階に突入したということかも知れません。AIに関して他国と共同した研究論文数などの出版物の数(Cross-Country Collaborations in AI Publications)については、中国と英国の共同研究が最も多く、中国と米国は2番手でした。英国や米国は中国をライバル視しているようにも見えますが、AIに関しては共同研究に励んでいるのが実態のようです。

※出典:AI Index Report 2023

一方、AIに対する法規制を行っている国は2022年の25か国から127か国に急増しています。AIの危険性への認識が深まっていることの証です。ウクライナ大統領のディープフェイク動画や米刑務所の通話監視などが注目を集めたとして、AIの利用などに対する法規制が進んでいることを指摘しています。

ウクライナ大統領のフェイク動画は見たことがある方も多いと思いますが、米刑務所の通話監視の話は、初めてだという方のために少し解説をします。米国の刑務所では受刑者が電話をかけることが許されており、刑務所側はこの通話を監視することが義務付けられています。ところが大量の通話が行われるため監視は、徹底されていませんでした。そこに登場したのがAWSの文字起こし技術(Amazon Rekognition*)とAIを利用したシステムです。AWSのこの機能は、APIを使用して簡単に導入することができます。このサービスを提供しているのがLEO Technologiesという会社です。問題のある通話記録には自動的にフラグが立つそうで、これまでに刑務所内に麻薬を持ち込む手口を発見したり、自殺しようとしている受刑者を発見したりと役立っているようです。ちなみに刑務所内で使用される言葉は特別で、例えば麻薬を注射するための自家製注射器を「ピンキー」と呼んだりします。そこでLEO Technologies社ではこうしたスラングを刑務所ごとに学習データセットに常に覚え込ませているそうです。こうした機能が刑務所だけでなく一般の通話にも利用されたら恐ろしい世の中になることは容易に想像できます。

*Amazon RekognitionはAWSの登録商標です。Recognition(認識)の間違いではありません。

AIに関する感情はネガティブに

2023年6月18日には英国でTortoise Mediaが世界のAIの開発状況についての報告書「 The Global Ai Index」を発表しています。評価指標を111項目設定し、政府報告書やシンクタンク、民間企業などの公開データベースから指標を算出し、世界62か国のAI開発状況をランキングしています。米国が100点満点で3年連続して第1位でした。2位は62点の中国。意外にも50点で3位にシンガポールが入っています。日本は、残念ながら34点で12位でした。日本は、もっとAIに力を入れていく必要がありそうです。

2023年7月26日には、米Stevens工科大学が「 AIに対する米国人の意識調査(Which U.S. Workers Are More Exposed to AI on Their Jobs )」を公表しています。AIが生活に与える影響について楽観的な回答をした人は2021年から10%減少して38%になったとしています。AIに対してネガティブな感情を感じる人の割合は44%でポジティブな感情を抱いている人の割合24%を大きく上回っています。AIの負の側面の理解が進んでいるようです。

あなたはAIを信じますか

2023年6月19日には、「 AIの回答結果に対する信用度合い(73% OF CONSUMERS GLOBALLY SAY TRUST CONTENT CREATED BY GENERATIVE AI)」について、コンサルティング会社のCapgemini Research Instituteが13か国、18歳以上の10,000人に行ったアンケート結果を公表しています。調査結果では73%の人が、AIが記述したコンテンツを信用すると回答しています。53%の人がAIによるファイナンシャルプランを信用する、医学的なアドバイスは67%の人が、効果があると回答しています。ちなみに回答者の14%は、ChatGPTなどの生成型AIのツールの存在を知らないと答え、52%の人はコンテンツ生成にAIを使用した経験があると回答しています。2023年8月10日に米Purdue大学が「ChatGPTのプログラミング(Who Answers It Better? An In-Depth Analysis of ChatGPT and Stack Overflow Answers to Software Engineering Questions )」結果では、ChatGPTが生成した回答の52%に誤りがあった、77%の人が、答えが冗長だったと回答しています。これはプログラミング技術に関するコミュニティStack Overflowで行ったアンケートで、多少なりともAIに関する知識があるグループでAIに関する信用度合いを調査すれば、違った結果が出ていたかも知れません。

生成AIのリスク

米バイデン大統領は、2023年10月30日にAIの「安心・安全・信頼できる人工知能の開発と利用に関する大統領令(Executive Order on the Safe, Secure, and Trustworthy Development and Use of Artificial Intelligence)」を公布しています。ホワイトハウスが同日公開したファクトシートでは、8つの論点が示されています。8つの論点とは、「安全性とセキュリティの新基準」、「米国民のプライバシー保護」、「公平性と公民権の推進」、「消費者・患者・学生の権利保護」、「労働者の支援」、「イノベーションと競争の促進」、「外国における米国のリーダーシップの促進」、「政府におけるAIの責任ある効果的な利用の促進」です。この大統領令には何日以内に何が達成されなければならないかが、具体的に各省庁への指示として記述されており、まさに米国のAIに関する国家戦略といえるもので、今年はこの大統領令に従ったガイドラインの発行や人材育成などの動向に注目する必要があります。

2023年11月1日には英国政府主催で「AI Safety Summit」が開催され、米国や中国を含む世界28カ国とEUが合意した「 ブレッチリー宣言(Bletchley Declaration)」が採択されています。この宣言では、サイバー安全保障やバイオテクノロジー、偽情報といった領域でAIが破滅的な被害をもたらしかねないとの懸念から法定枠組みの構築や国を跨いだ協力と拡大がうたわれました。高機能な汎用AIや特定の限定型AIモデルで潜在的な意図しない誤用や人間の意図に整合しない制御が起こることが心配されています。

AIのリスク認識が深まる中、2023年12月1日には、広島でG7デジタル・技術大臣会合が開かれ「 すべてのAI関係者向けの広島プロセス国際指針」が発表されました。この指針では、すべてのAI関係者は「高度なAIシステムの信頼できる責任ある利用を促進し、貢献する」としています。

国連も関心を寄せるAIのリスク

2023年12月7日にはニューヨークの国連本部では、ガートナー事務総長が「地政学的な対立の中、AIに関わる競争で混乱が起きるのは不可避だ」と述べて国際協調を促進する仕組みの必要性を訴えています。ガートナー事務総長はこれに先立つ2023年10月25日にAI活用におけるリスクと不確実性に対する唯一の対処はグローバルなAIガバナンスであるとして、世界各国から39名の専門家を招集し、国際社会によるAI管理を支援する新たな諮問機関 High-level Advisory Body on Artificial Intelligenceを立ち上げています。

重要になるAIガバナンス規制

このほか中国ではサイバースペース管理局が2023年8月15日に施行した「生成AIサービス管理暫定法(生成式人工智能服务管理暂行办法)」などがあります。OpenAI社が2022年11月30日に対話型AI「ChatGPT」を公開してから1年の内にAIがもたらすリスクについて世界中で議論が行われ、規制法案が作成されるなど、急速に制度整備が行われていることが理解できるでしょう。

2023年11月29日にはOpenAI社から解任されたサム・アルトマン氏がCEOに返り咲きしました。このわずか4日間の解任からCEOへの復帰には、様々な説がありますが、気になるのは汎用人工知能(AGI:Artificial General intelligence)の開発があるのではないか、というものです。OpenAI社の次の開発目標として、高度なAIの開発プロジェクト「Q*(キュースター)」があります。AGIは人ができることを人と同等かそれ以上の多くの作業がこなせるAIで、これが完成すると人はAIを制御できなくなるのではないか、ともいわれています。Q*の開発動向も今年目が離せないテーマです。

(了)

※本記事の内容は執筆者個人の見解であり、所属する組織の見解を代表するものではありません。