目次

はじめに

約1年前の2025年3月に、総務省と経済産業省が、『ワット・ビット連携官民懇談会』の開催を発表しました。国内でもAIデータセンターの需要が急速に拡大しており、電力と通信の効果的な連携が必要との判断のもと、官民の関係者による連携・協調の場が開始されました。そして、2025年6月には、『ワット・ビット連携官民懇談会取りまとめ1.0』が公表され、データセンターを地方に分散していく方向性が示されています。

今回の題材である『分散型AIデータセンター』は、AIデータセンターの地方分散後の次のステップとなる可能性があるものです。また、この『分散型AIデータセンター』は、日本国内だけではなく、USでも話題が増加しています(日本国内はPoC(Proof of Concept:概念実証)段階に対し、USでは商用が稼働)。本Blogではその動向を紹介します。

スケールアクロス(=分散型AIデータセンター)

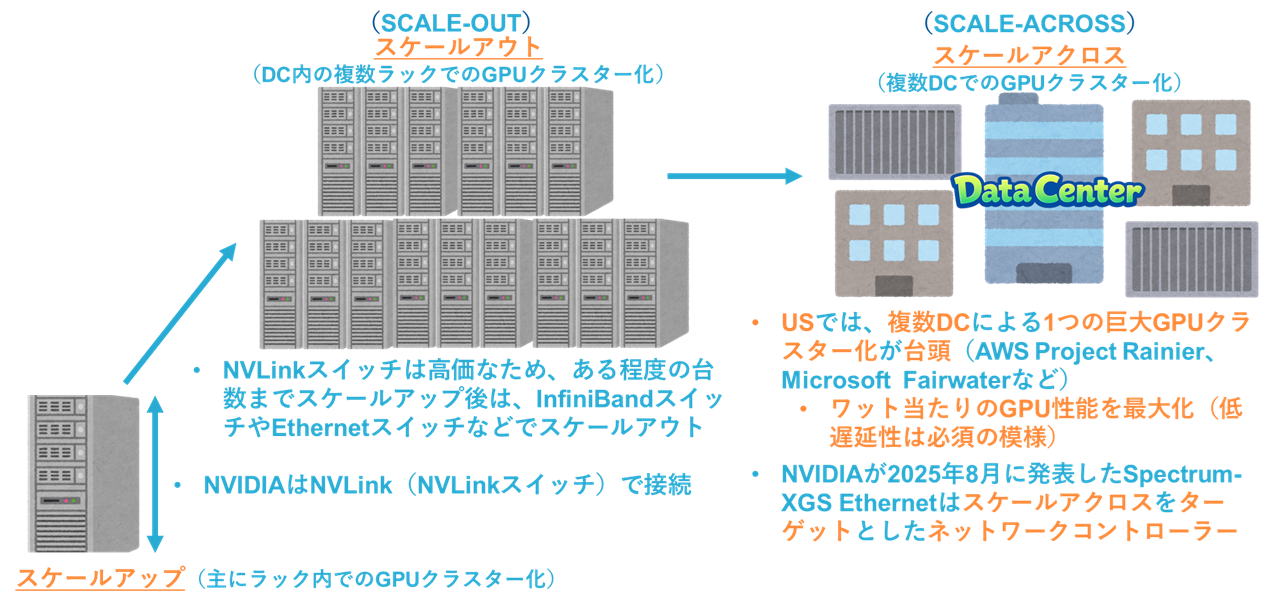

これまで、GPUサーバーによる処理能力を向上させる方法として、『スケールアップ(主にラック内でのGPUクラスター化により処理能力を向上)』と『スケールアウト(複数ラックでのGPUクラスター化により処理能力を向上)』が知られていましたが、2025年8月にNVIDIAが発表した『Spectrum-XGS Ethernet』と共に、新たに『スケールアクロス』が出現しました。

『スケールアクロス』は複数データセンターでのGPUクラスター化により処理能力を向上させるものです。『スケールアップ』と『スケールアウト』は、AI向けのGPUサーバーに限らずサーバーやシステムの処理能力を向上させる方法として以前から存在していたのに対し、『スケールアクロス』は空前のAIブームであるこのタイミングで出現した方法です。そのため、現時点では『スケールアクロス』=『分散型AIデータセンター』と捉えています。

NVIDIAの『Spectrum-XGS Ethernet』は、複数のAIデータセンターを相互に接続したギガスケール級の大規模なAIデータセンター形成に寄与する、ネットワークコントローラー相当の製品となるようです。データセンター間の距離に応じた輻輳制御の自動調整や精密な遅延管理などにより、2つのデータセンターを接続した際のスループットが約1.9倍になるとうたい、複数AIデータセンターでの巨大GPUクラスター化を実現するそうです(その結果、処理能力が向上)。

事例:分散型AIデータセンター

USの事例

まず、USにおける事例です。NVIDIAの『Spectrum-XGS Ethernet』については、ネオクラウドプロバイダーであるCoreWeaveが最初の導入企業に含まれることがリリース発表時に明記されていました。なお、ネオクラウドとは、GPUのリソース提供に特化したクラウドサービスのことで、AWSやMicrosoft Azureなどの何でもそろうクラウドサービスプロバイダー(ハイパースケーラー)と区別するためにこう称され、欧米では2025年にその市場規模が大きく拡大し、今後も大きな成長が予測されています。

CoreWeaveが既に商用稼働しているかどうかは分かっていませんが、その他で商用稼働しているものとして、AWSのProject RainierとMicrosoftのFairwaterが存在します。なお、USでは、生成AIのモデルサイズが増大し続けている生成AIサービス提供者向けに、AIデータセンターを大規模化し処理能力を向上する分散型AIデータセンターがほぼ必須になっています(AWS Project RainierはAnthropic向け、Microsoft FairwaterはOpenAI向けとなるそうです。また、ネオクラウドプロバイダーの現在の主な利用者は生成AIサービス提供者で、一般の企業はほとんど存在しない模様です)。

日本の事例

続いて、日本での事例です。日本では、IOWN APNと連携したPoCが多数実施されています(当社における事例はこちら)が、USのようにAIデータセンターの大規模化を目的とした商用稼働はまだありません。そして、その多くが、これまでデータセンター内で完結していたGPUクラスターの複数データセンターでの形成や、遠隔に存在するGPUがIOWN APNを介して推論処理を実行するといった、『低遅延性』を必要とするケースが多いです。

また、日本には、USのような規模での生成AIサービス提供者がほぼ存在しない(例:OpenAIやAnthoropicと同様のサービス提供者が存在しない)ため、今後もUSで商用稼働が開始されたような複数データセンターによる巨大なGPUクラスターが必要となる可能性は低いかもしれません。しかし、ワット・ビット連携が推進することで、北海道や九州などに新たなデータセンター集積地が形成されるようになる可能性が高いことや、コンテナ型データセンターなどの小型データセンターを短期間に新設するケースも増えていることがあり、近い将来、複数の小型AIデータセンターによる分散型AIデータセンターが商用稼働するのではないかと考えています。

おわりに

USと日本ではその目的は異なりますが、分散型AIデータセンターが大きく前進しています。USでは生成AIサービス提供者向けの大規模AIデータセンターがその中心にあるのに対し、日本ではまだユースケースが固まっていません。しかし、『低遅延』をコアとするIOWN APN連携のPoCが数多くあります。そして、日本における分散型AIデータセンターの今後の更なる発展には、『企業による利用』がどれだけ拡大するかがポイントになるかもしれません。

※本記事の内容は執筆者個人の見解であり、所属する組織の見解を代表するものではありません。