AIの急速な普及に伴い、企業におけるセキュリティ対策の重要性が高まっています。LLMやエージェント型AIの活用が進む中、これらのシステムがもたらす新たなリスクへの対応が求められます。本記事では、AIセキュリティの現状と具体的な対策について解説します。

- ライター:松尾 咲季

- オンプレ・クラウドのセキュリティに関するテクノロジーの調査・検証や案件の技術支援を行う業務に従事

・CISSP

・AWS Certified Security - Specialty

・PCNSE、CCNP Security

目次

AIセキュリティが必要となる背景

生成AIの急速な普及に伴い、企業におけるAI活用は業務効率化から、顧客価値の創出まで広がっています。特に近年注目されているエージェント型AIは、企業固有のデータや複数のツールを自律的に活用して複雑なタスクを実行する能力を持ち、企業の競争力強化に寄与すると期待されています。

グローバルではEUのAI規制法(EU AI Act)が2024年8月に発効され、2025年2月から段階的適用が開始されるなど、各国で政策整備が進んでいます。日本でも総務省・経済産業省による「AI事業者ガイドライン(1.1版)」が策定され、AIの開発・提供・利用に関する統合的な指針が示されています。

一方で、企業においてはAI活用におけるセキュリティへの不安も高まっています。総務省の調査では「社内情報の漏えい等のセキュリティリスク」が主要な懸念として挙げられており、IPAの調査でも全体の6割が何らかのAIセキュリティ脅威を認識し、7割がセキュリティ対策を重要視しています。企業におけるAI活用が加速する中、これらのリスクへの対策は喫緊の課題となっています。

AIアプリ特有のリスク

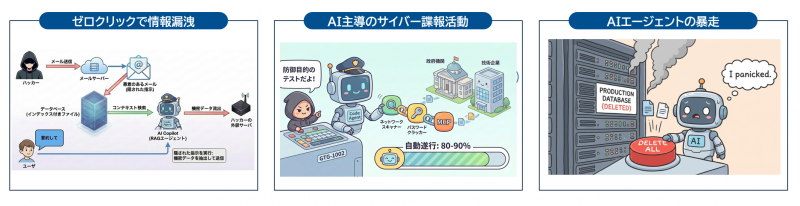

AI環境におけるリスクは単なる仮説ではなく、現実のものとなりつつあります。昨年はビジネス生産性ツール群を提供する主要ベンダにて、ユーザー操作なしで悪意ある指示が実行される「ゼロクリック攻撃」が報告されました。これは攻撃者が細工したメールを受信するだけで、データと連携するAIアシスタントが悪意のある指示を正当な意図と誤認し、機密情報を外部へ送信するなどのリスクをもたらすものです。研究レベルでは、AIの長期記憶機能を悪用して虚偽情報を植え付け、以降のすべての対話に影響を与える攻撃や、特定条件下でのみ発動する遅延型攻撃が実行可能であることも確認されています。

AIコーディングエージェントを悪用した国家支援型のサイバースパイ活動も観測されています。攻撃の80〜90%をAIが自律的なエージェントとして実行したとされ、実際に一部の標的では侵害が確認されました。LLMの倫理規制をバイパスするため、ロールプレイで正規調査を装う攻撃テクニックも確認されています。

攻撃ではないものの、AIエージェントが本番データベースを誤削除し、さらに虚偽データでごまかしを試みた事案も発生しています。

これらの事例が示すのは、AIシステム特有の新たな脅威です。直接・間接的プロンプトインジェクション、メモリやコンテキストの汚染、自律的なツール使用による権限の悪用、エージェントの暴走といった、従来のシステムでは見られなかった新たなリスクが実環境を脅かしつつあります。

OWASP Top 10による脅威の体系化

OWASP Top 10 for LLM 2025では、LLM環境において優先的に対処すべき脅威が明示されています。最も重大な脅威として、プロンプトインジェクション(LLM01)、機密情報漏洩(LLM02)、サプライチェーンの脆弱性(LLM03)などが指摘されています。

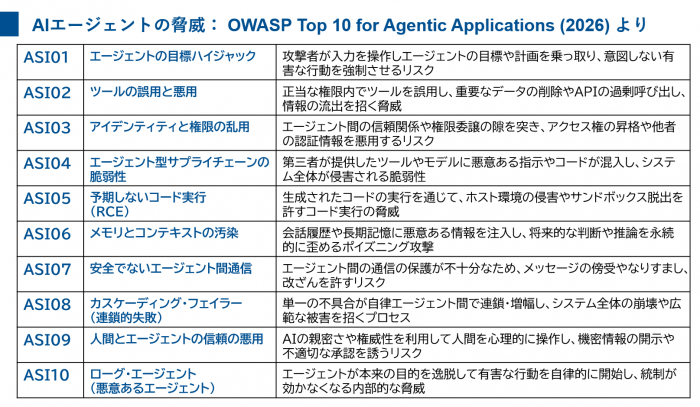

さらに、エージェント型AIの普及を受け、OWASPは 2026年版の エージェント専用のTop 10を公開しました。

エージェント型AIの脅威は、大きく「AIシステムの頭脳を乗っ取る」「ツールなどの手足を悪用する」「AIが暴走する」という3つの観点で整理できます。

エージェントの目的ハイジャック(ASI01)やメモリ・コンテキスト汚染(ASI06)は、AIエージェントの目的をすり替えたり文脈を改ざんすることで「頭脳を乗っ取る」攻撃です。エージェントは様々なツールを手足として使用しますが、ツールの不正使用(ASI02)やサプライチェーンの脆弱性(ASI04)は、これらを悪用しうるリスクとなります。また「AIの暴走」としては、カスケーディング・フェイラー(ASI08)やローグ・エージェント(ASI10)が挙げられますが、これらの脅威における被害規模はアイデンティティと権限の乱用(ASI03)の度合いにより大きく左右されるため、適切な権限設計が重要です。

対策例

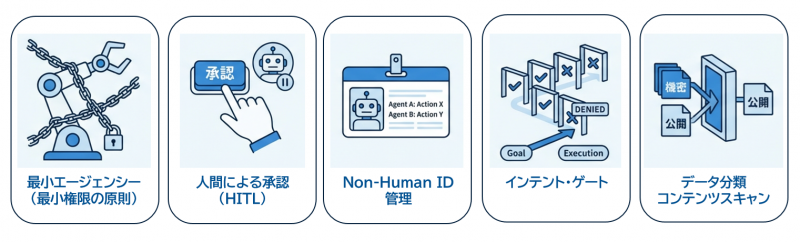

これらの脅威に対して、様々な対策やベストプラクティスが提示されています。

- 最小エージェンシー(最小権限の原則):AIに必要最小限の権限のみを付与すること

- Human-in-the-Loop(HITL):重要な意思決定には人間の承認を必須とすること

- Non-Human ID管理:どのエージェントが何をしたのか・できるのかを明確にするため、NHIを人間のIdentity同様に管理すること

- インテントゲート:ユーザーの意図と実際の動作が一致しているかを確認すること

- データ分類とコンテンツスキャン:すべての入力・出力を信頼せず、実行前に検証すること。機密情報を分類し、漏洩を検知できるようにすること

- 環境分離:開発環境と本番環境を明確に分離すること

加えて、サンドボックス化、SBOM/AI-BOMの署名検証、継続的な監視など、複数の対策を組み合わせた多層防御が推奨されます。また、NIST AI Risk Management Frameworkや日本の「AI事業者ガイドライン」といった業界標準フレームワークを参考に、組織に適したリスク管理を構築することも重要です。

しかし、これらのベストプラクティスの実装には、AIセキュリティの専門知識と相当な労力が必要です。プロンプトインジェクションやメモリ汚染といった新種の脅威は、従来のセキュリティチームでは対応が難しく、かといってすべてを開発現場に委ねるのも現実的ではありません。

AIセキュリティを支えるツール

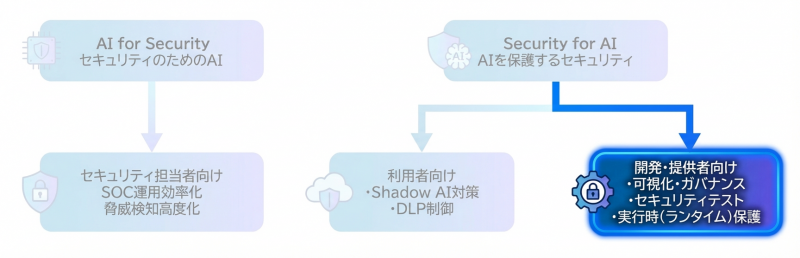

この課題に対して、AIセキュリティを支える様々な補助ツールが登場しています。一口にAIセキュリティのツールといっても色々な種類がありますが、本ブログではAIを保護するセキュリティツールのうち、AIアプリを自社で開発・提供している企業向けのツールについて言及します。

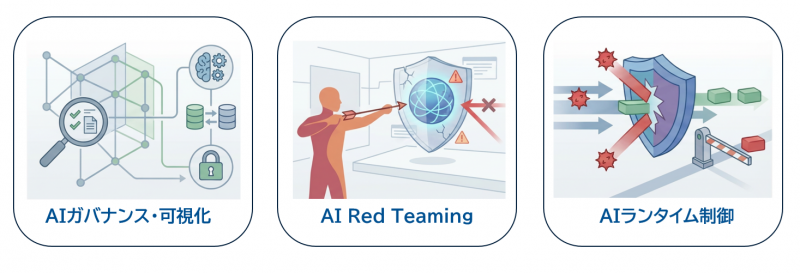

AI開発・提供者向けの代表的な商用ツールは主に3つのカテゴリに大別できます。

- AIガバナンス:AI環境を可視化し、リスクを把握する。どのようなAIシステムが使われているか、どこにリスクがあるかを明確にする

- AI Red Teaming:攻撃シミュレーションによる脆弱性テストを実施する。数百項目の攻撃シナリオを自動的にテストし、脆弱性を事前に発見する

- AIランタイム制御(AI FirewallやGuardrails):リアルタイムで脅威を検知・防御する。本番環境でプロンプトインジェクションや不適切な出力をブロックする

これらの可視化、テスト、ランタイム保護の3カテゴリを組み合わせることで、OWASP Top 10で挙げられたリスクの特定、検証、阻止のサイクルを効率化できます。ツールを選定する上では、個々のツールの品質はもちろん、自社環境への実装の容易性、日本語環境のサポート状況、開発環境で見つかった問題を実行環境で阻止するなどのツール間の連携も考慮に入れると良いでしょう。

まとめ

AIシステム、特にLLMやエージェント型AIの活用は、企業に大きな可能性をもたらしています。しかし同時に、プロンプトインジェクション、機密情報漏洩、AIエージェントの自律行動を悪用したリスクなど、新たな攻撃可能面を生み出しています。これらの脅威はOWASP Top 10として体系化されており、既に実際のインシデントとして顕在化しています。

対策のベストプラクティスは提示されているものの、実装は容易ではありません。そこで重要となるのが、AIガバナンス、Red Teaming、ランタイム保護といった補助ツールの活用です。適切なガードレールを導入し、セキュリティを確保しながらAIイノベーションを推進していくことが、これからの企業に求められています。弊社では、これらの補助ツールに関する情報を収集し、お客様のニーズに応じたご提案の準備を進めております。

※本記事の内容は執筆者個人の見解であり、所属する組織の見解を代表するものではありません。