- ライター:占部 蒼馬

- 2021年ネットワンシステムズに新卒入社し、Cisco UCS/Intersightの製品担当として従事。

現在はデータ分析やAI活用などにも取り組んでいる。

目次

はじめに

昨今、多くの企業において生成AIの活用が当たり前となり、外部サービスを単に利用するだけでなく、モデルやサービスを内製化する動きが活発となっています。

特に、「RAG(検索拡張生成)」や「ファインチューニング」といった技術を用いて社内にあるデータをAIに組み込む動きが加速しており、クラウドに加えてオンプレミス基盤での運用需要も増加傾向にあります。

しかし、その基盤となるインフラストラクチャの構築には、サーバー、スイッチ、ストレージといった各コンポーネントの高度な専門知識に加え、それらの複雑な互換性検証が不可欠です。これらは導入における障壁となり、AI利活用のスピードを鈍らせることにつながります。

本記事では、こうしたAIインフラ基盤構築の課題を解決するためにCisco Systems社(以下「Cisco」)が提供する統合インフラソリューション「Cisco AI PODs」について、その概要と導入メリットをご紹介します。

Cisco AI PODsとは?

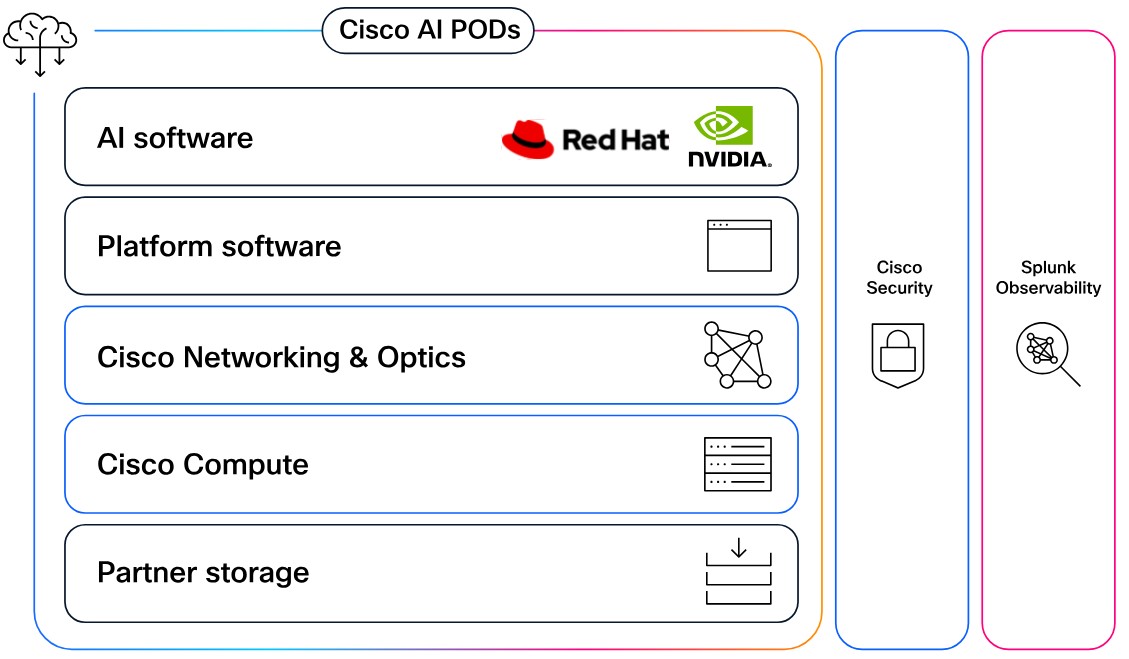

Cisco AI PODsは、AIワークロードに必要なコンポーネントを組み合わせ、Ciscoが事前に検証を行ったフルスタック構成のリファレンスアーキテクチャであり、その構成を提供するソリューションです。

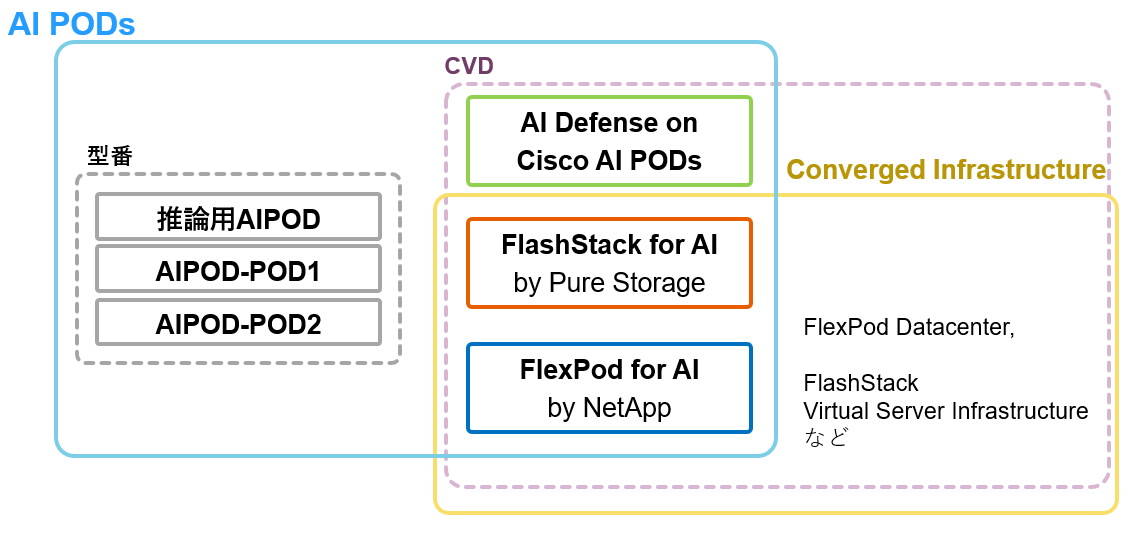

リリース当初はCisco UCS X-Seriesをベースとした推論向けの構成(UCSX-AI-RAG etc.)が主でしたが、現在ではUCS C885A M8やUCS C845A M8といった高性能GPUサーバーもポートフォリオに加わり(AIPOD-POD1,POD2)、リファレンスアーキテクチャだけでなく型番としてのAI PODsも拡充されています。これにより、LLM(大規模言語モデル)の学習や大規模な推論環境など、よりハイパフォーマンスな要求に対してもAI PODsで対応できるようになりました。

さらに、AI PODsにはハードウェアだけでなく、AI活用に不可欠なソフトウェアも統合されています。具体的には、AI ワークロードを管理するための強力な基盤を提供する「NVIDIA AI Enterprise」や、コンテナ化された AI アプリケーションのオーケストレーションと展開を簡素化する「Red Hat OpenShift」が用意されています。

引用:Cisco AI PODs - Accelerate Enterprise AI Infrastructure - Cisco

Cisco AI PODsの主な利点

Cisco AI PODsを採用することで、AI/ML基盤を個別のコンポーネントから構築する場合と比較して、以下のような利点があります。

1. 導入期間の短縮とリスクの低減

最大の特徴は、Ciscoが提供する検証済みデザイン「Cisco Validated Designs (CVD)」がベースにあることです。インフラ構築時に発生する、機器選定やファームウェア間の互換性検証といった複雑なプロセスは既に完了されており、CVDによって担保されています。

これにより、インフラ導入時に発生しうる技術的な手戻りリスクを低減し、AI導入を円滑に進めることが可能となります。

このアプローチは、これまでFlexPodやFlashStackといった統合インフラストラクチャ(Converged Infrastructure)が提供してきたものであり、それぞれに用意されていたAI向けのCVDがAI PODsとして再整備されているようなイメージです。

2. 運用の簡素化

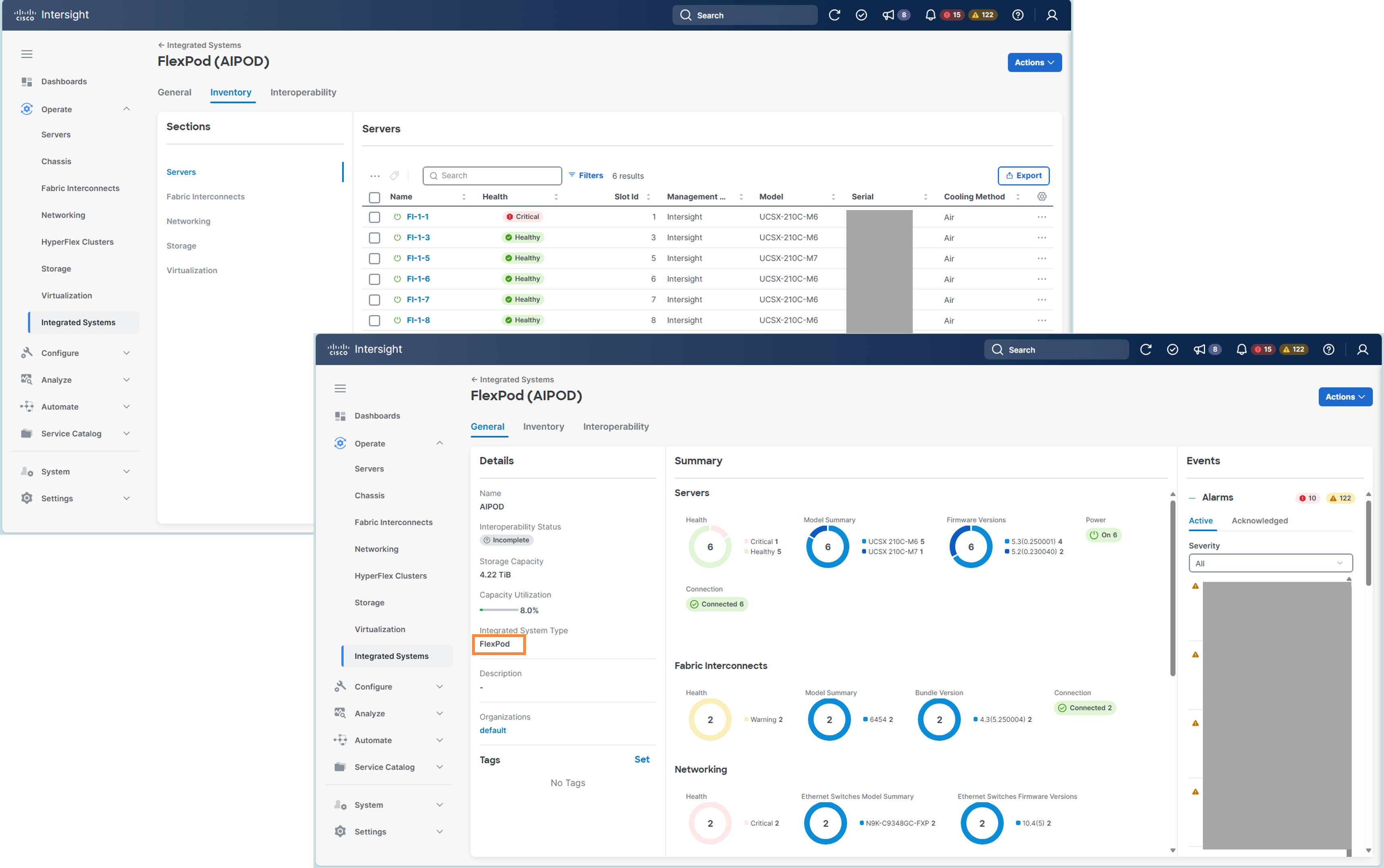

インフラの管理は、これまでのブログでも紹介してきた「Cisco Intersight」で統合することができます。

サーバーやネットワークスイッチに加え、サードバーティベンダのストレージを含むインフラ全体を単一のダッシュボードから可視化・管理できます。

日々の運用監視や、ファームウェアのアップデートといった作業を効率化および自動化でき、運用担当者の負荷軽減に寄与します。

以下の画面はIntersightで推論用AI PODの環境にNetApp社のストレージを追加し、FlexPodとして登録したものです。

3. 柔軟な拡張性

AI利活用の促進に伴い、オンプレミス基盤の拡張が必要になった場合でもAI PODsは柔軟に対応できます。

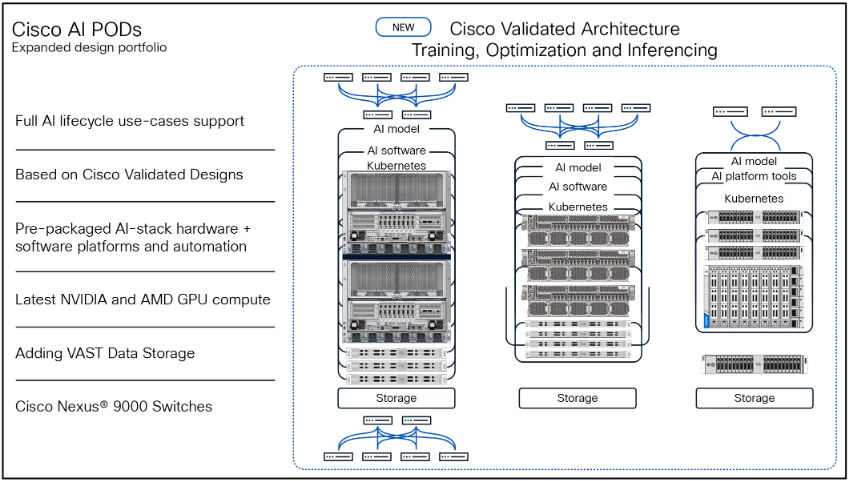

Cisco AI PODsは、UCS X-Seriesの持つモジュラーシステムと「Scale Unit」という概念によって柔軟性と拡張性を実現しています 。Scale Unitとは、AIワークロードに最適化されたUCSコンピュートノードとNexusリーフスイッチペアをひとつの構成単位としてまとめたものです 。

単に「推論か学習か」という目先の用途だけでなく、将来のAI活用ロードマップに合わせて、以下のアプローチから最適な導入を開始することができます 。

- 推論用AIPOD:小規模な推論ワークロード向け。UCS X-Seriesのモジュラーシステムを活用し、データセンター基盤に柔軟にAI機能を統合可能。

- AIPOD-POD1:学習済みモデルの即時運用に利用。エッジや拠点へ迅速に展開でき、AIインフラ基盤の迅速な展開を実現。

-

AIPOD-POD2:モデルの構築やファインチューニングを行う場合に適する。Scale Unitによる拡張性があり、大規模環境にも対応。

引用:Cisco AI PODs Expanded design portfolio

まとめ

本記事では、AIインフラ基盤構築をシンプルに実現可能にする「Cisco AI PODs 」をご紹介しました。

インフラの複雑性を排除することは、本来注力すべき「データ利活用」や「生成AIモデルの開発」などにリソースを集中させることにつながります。

弊社では今後も、AI PODsに関連するさまざまな検証を行ってまいります。AIインフラ基盤の導入をご検討の際は、弊社担当営業までご連絡ください。

※本記事の内容は執筆者個人の見解であり、所属する組織の見解を代表するものではありません。